Trong thế giới phát triển Backend, có hai cơn ác mộng lớn nhất mà mọi kỹ sư đều phải đối mặt khi ứng dụng bắt đầu có lượng người dùng lớn: Tốc độ phản hồi rùa bò và Server sập nguồn vì quá tải (DDoS, Spam Request).

Làm thế nào để đưa thời gian phản hồi (Response Time) của hệ thống từ vài giây xuống dưới mốc 100ms lý tưởng? Làm sao để server vẫn đứng vững khi có hàng chục ngàn request ập đến cùng lúc? Chìa khóa để giải quyết triệt để bài toán này chính là sự kết hợp hoàn hảo giữa Redis Caching và Rate Limiting.

1. Redis Caching: "Động Cơ" Tăng Tốc API Gấp 10 Lần

Mỗi lần API của bạn nhận một request yêu cầu lấy danh sách sản phẩm, nó phải mở kết nối đến Database (MySQL/MongoDB), thực hiện các phép truy vấn phức tạp (JOIN, Aggregate), rồi mới gom dữ liệu trả về cho người dùng. Quá trình này tiêu tốn rất nhiều I/O của ổ cứng và CPU.

Redis (Remote Dictionary Server) xuất hiện như một vị cứu tinh. Hoạt động hoàn toàn trên bộ nhớ RAM (In-memory), tốc độ đọc/ghi của Redis nhanh hơn Database thông thường gấp hàng trăm lần.

Để áp dụng Caching hiệu quả, bạn không chỉ "lưu bừa" dữ liệu vào Redis mà cần xây dựng một chiến lược cực kỳ chặt chẽ:

-

Thiết lập Cache Params thông minh: Không phải người dùng nào cũng gọi API giống nhau. Bạn cần tạo ra các khóa lưu trữ (Cache Key) linh hoạt dựa trên URL và Query Parameters (ví dụ:

products:page=1&limit=20:category=tech). Điều này đảm bảo mỗi bộ lọc của người dùng đều được tối ưu tốc độ. -

Chiến lược TTL (Time To Live): Dữ liệu không thể nằm mãi trong RAM vì RAM rất đắt đỏ. Mọi Cache Key đều phải có thời gian sống (TTL). Ví dụ: Danh mục sản phẩm có thể cache 1 ngày, nhưng thông tin khuyến mãi Flash Sale chỉ nên cache trong 1 phút.

-

Nghệ thuật Cache Invalidation (Xóa bộ nhớ đệm): Đây là bài toán khó nhất trong Khoa học máy tính. Nếu Admin vừa cập nhật giá một sản phẩm (Update/Delete), bạn phải lập tức xóa (Invalidate) Cache cũ. Nếu không, người dùng sẽ liên tục nhìn thấy dữ liệu "thiu" (Stale Data). Hệ thống cần các Event Listener hoặc Trigger để dọn dẹp Cache chính xác mỗi khi có thay đổi trong Database.

2. Rate Limiting: "Tấm Khiên" Bảo Vệ Server Khỏi Sập Nguồn

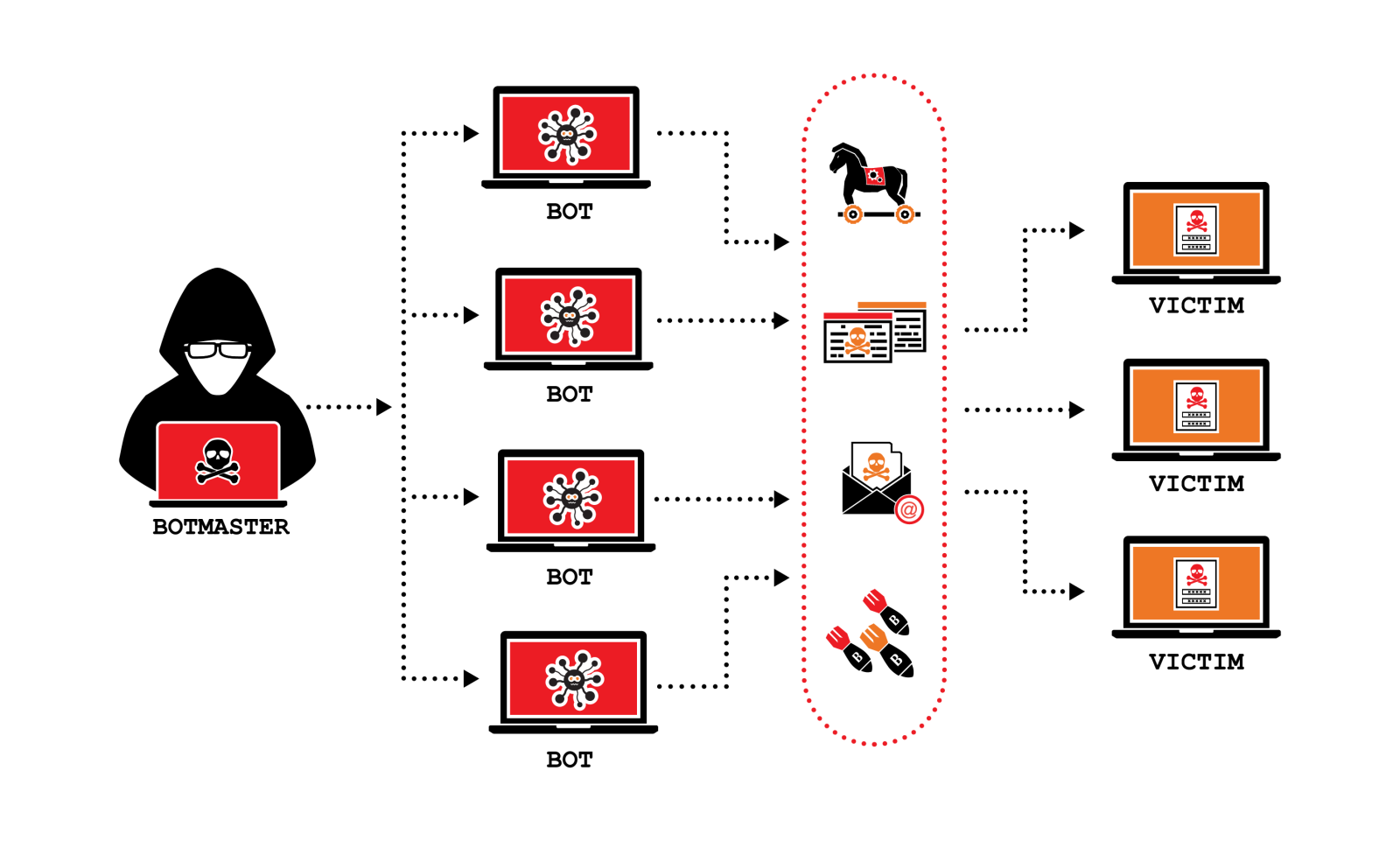

Khi API của bạn đã chạy mượt mà, rủi ro tiếp theo là việc bị lợi dụng. Một hacker hoặc một botnet có thể gửi hàng ngàn request mỗi giây vào API Đăng nhập để dò mật khẩu, hoặc spam API Tìm kiếm làm cạn kiệt tài nguyên Server.

Đây là lúc Rate Limiting (Giới hạn lưu lượng) phát huy tác dụng. Nó thiết lập một rào cản: "Mỗi IP/Người dùng chỉ được phép gọi API này 100 lần/phút". Vượt quá con số này, Server sẽ chặn ngay lập tức và trả về mã lỗi 429 Too Many Requests.

Tại sao lại dùng Redis để làm Rate Limiting mà không phải bộ nhớ của Server (Memory)? Bởi vì khi bạn chạy Microservices với nhiều máy chủ (Load Balancing), các máy chủ cần một nơi lưu trữ trung tâm để đếm số lượng request một cách đồng nhất.

Dưới đây là hai thuật toán chuyên sâu thường được ứng dụng để kiểm soát lưu lượng:

A. Thuật toán Fixed Window (Cửa sổ cố định)

Đây là cách tiếp cận cơ bản nhất. Hệ thống chia thời gian thành các "cửa sổ" cố định (ví dụ: từ 12:00 đến 12:01). Mỗi request đến sẽ tăng biến đếm lên 1. Nếu vượt quá 100, chặn request. Sang phút mới, biến đếm reset về 0.

-

Ưu điểm: Dễ hiểu, tiết kiệm bộ nhớ.

-

Nhược điểm: Hiệu ứng "gấp đôi lưu lượng" ở rìa cửa sổ. Ví dụ: Kẻ tấn công gửi 100 request ở giây thứ 59 và gửi tiếp 100 request ở giây thứ 01 của phút tiếp theo. Hệ thống phải chịu 200 request chỉ trong 2 giây mà không hề bị chặn.

B. Thuật toán Sliding Window Log (Cửa sổ trượt)

Để khắc phục nhược điểm trên, Sliding Window Log sử dụng Sorted Sets (ZSET) trong Redis. Nó lưu lại chính xác timestamp (thời gian tính bằng mili-giây) của từng request. Khi có request mới đến, hệ thống sẽ xóa các timestamp cũ hơn 1 phút trước đó, đếm số lượng timestamp còn lại. Nếu nhỏ hơn 100, cho qua; nếu lớn hơn, chặn lại.

-

Ưu điểm: Cực kỳ chính xác, chặn đứng hoàn toàn các luồng tấn công tăng đột biến ở bất kỳ thời điểm nào. Đảm bảo API luôn hoạt động trong ngưỡng an toàn tuyệt đối.

-

Nhược điểm: Tiêu tốn nhiều bộ nhớ RAM hơn để lưu trữ các log thời gian.

Kết luận

Một hệ thống xuất sắc không chỉ nằm ở việc code chạy đúng chức năng, mà còn ở việc nó chịu đựng được sức ép của thế giới thực như thế nào.

Bằng cách trang bị bộ đôi Redis Caching (để tối ưu hóa tốc độ và giảm tải Database) cùng với Rate Limiting (để ngăn chặn các luồng traffic độc hại), bạn đang biến một ứng dụng Node.js mong manh thành một "pháo đài" bất khả xâm phạm. Đây chính là tư duy cốt lõi của một Backend Architect mà chúng ta sẽ đi sâu vào thực hành mã nguồn trong các bài giảng tiếp theo của khóa học.